视频大数据时间,真实来了!

刚刚,李飞飞的斯坦福团队同谷歌合营,推出了用于生成传神视频的扩散模子W.A.L.T。

这是一个在分享潜在空间中测验图像和视频生成的,基于Transformer的扩散模子。 英伟达高档科学家Jim Fan转发驳斥谈:2022年是影像之年,2023是声波之年,而2024,是视频之年!

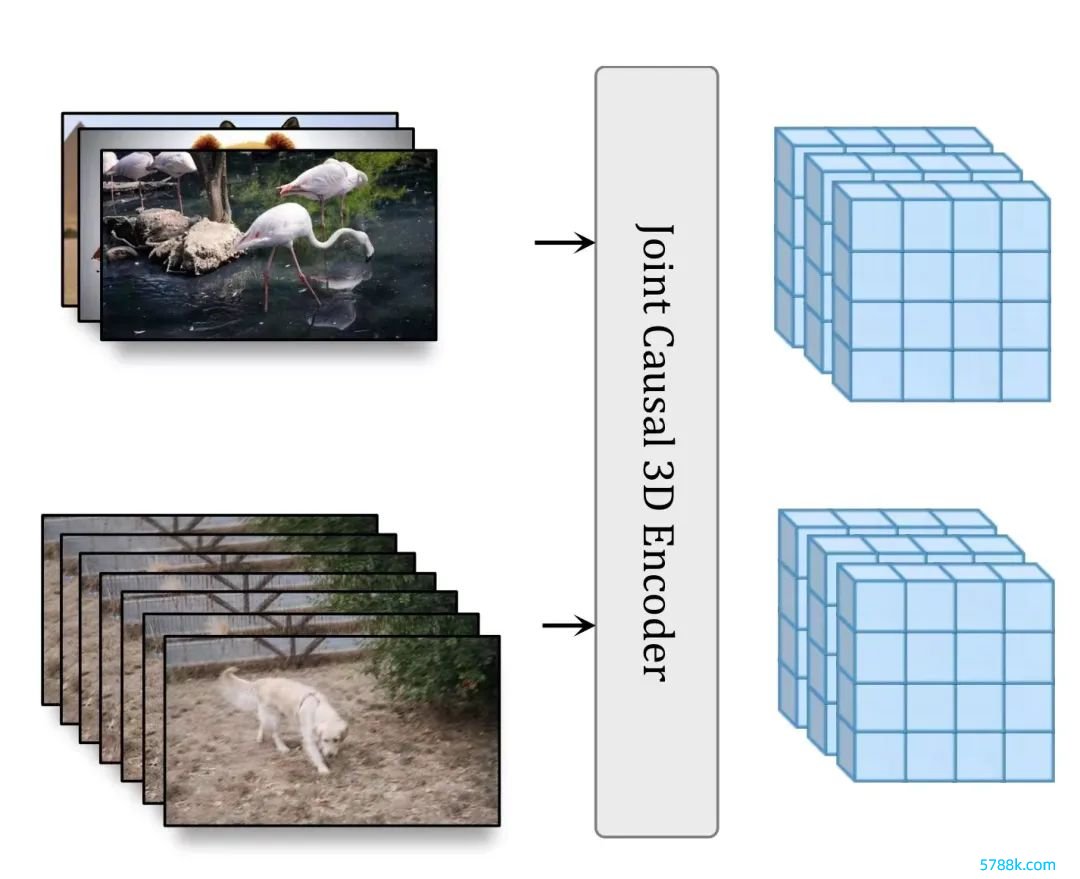

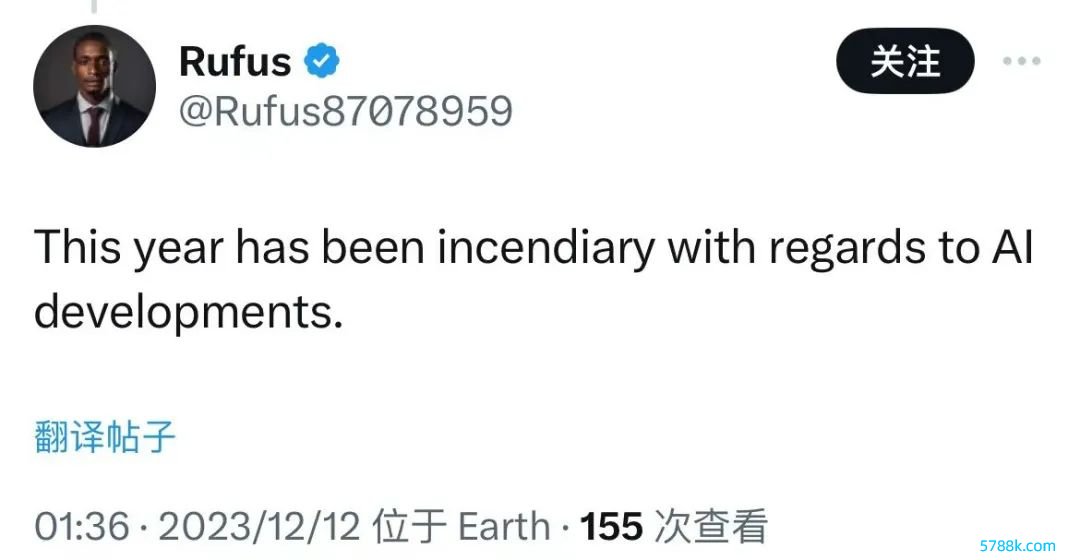

这是一个在分享潜在空间中测验图像和视频生成的,基于Transformer的扩散模子。 英伟达高档科学家Jim Fan转发驳斥谈:2022年是影像之年,2023是声波之年,而2024,是视频之年!  开头,计议东谈主员使用因果编码器在分享潜在空间中压缩图像和视频。

开头,计议东谈主员使用因果编码器在分享潜在空间中压缩图像和视频。 其次,为了进步顾虑和测验服从,计议东谈主员使用基于窗口防范的变压器架构来进行潜在空间中的皆集空间和时刻生成建模。

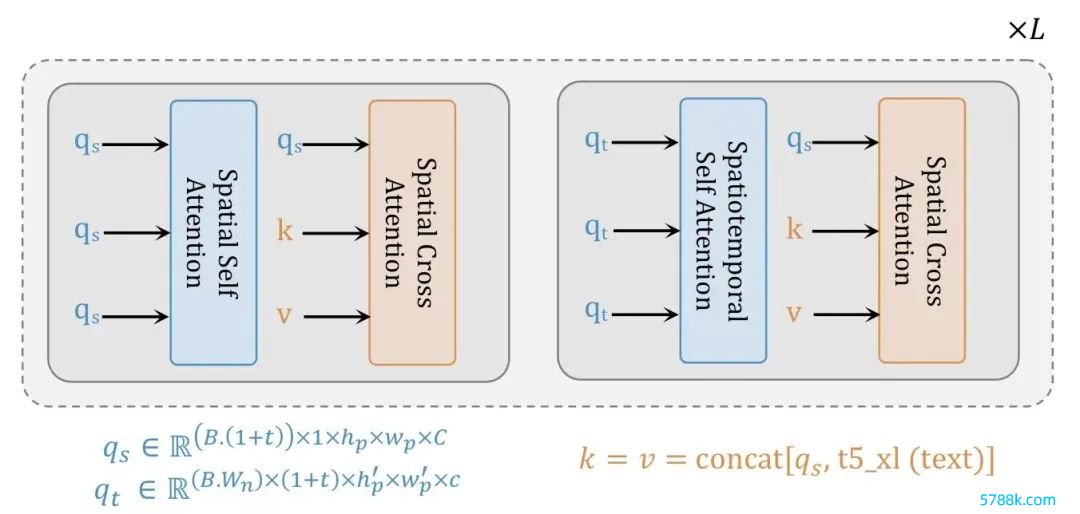

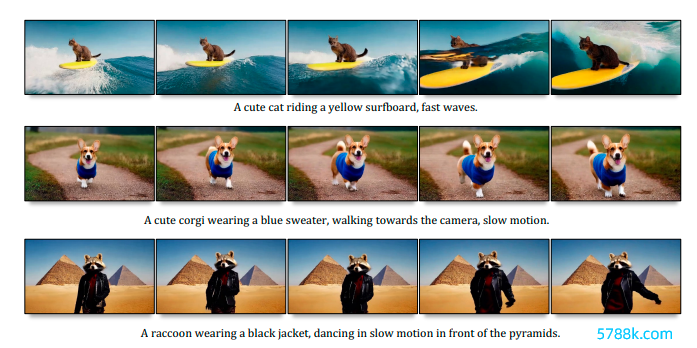

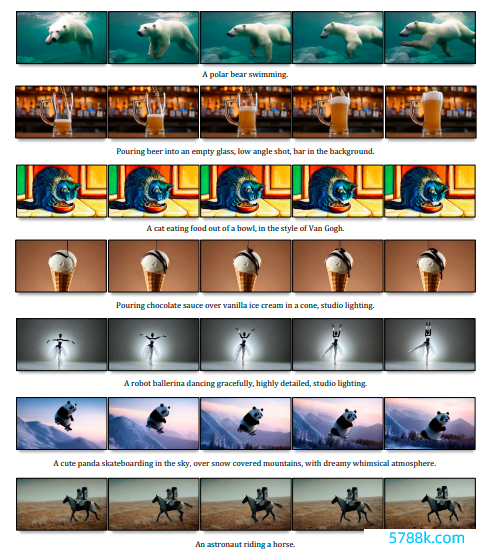

其次,为了进步顾虑和测验服从,计议东谈主员使用基于窗口防范的变压器架构来进行潜在空间中的皆集空间和时刻生成建模。  计议东谈主员的模子不错根据当然讲话教导生成传神的、时刻一致的引导:

计议东谈主员的模子不错根据当然讲话教导生成传神的、时刻一致的引导:  A Teddy bear skating carefully in Times Square,Slow Motion/一只泰迪熊在时间广场上优雅的溜冰,慢动作

A Teddy bear skating carefully in Times Square,Slow Motion/一只泰迪熊在时间广场上优雅的溜冰,慢动作  Pouring chocolate sauce over vanilla ice cream in a cone, studio lighting/将巧克力酱倒在香草冰淇淋甜筒上,服务室灯光

Pouring chocolate sauce over vanilla ice cream in a cone, studio lighting/将巧克力酱倒在香草冰淇淋甜筒上,服务室灯光  An stronaust riding a horse/别称宇航员骑着马

An stronaust riding a horse/别称宇航员骑着马  A squirrel eating a burger/一只松鼠在吃汉堡

A squirrel eating a burger/一只松鼠在吃汉堡  A panda taking a selfie/一只正在自拍的熊猫

A panda taking a selfie/一只正在自拍的熊猫  An elephant wearing a birthday hat walking on the beach/一头戴着寿辰帽的大象在海滩上行走

An elephant wearing a birthday hat walking on the beach/一头戴着寿辰帽的大象在海滩上行走  Sea lion admiring nature, river, waterfull, sun, forest/海狮观赏当然,河流,瀑布,阳光,丛林

Sea lion admiring nature, river, waterfull, sun, forest/海狮观赏当然,河流,瀑布,阳光,丛林  Pouring latte art into a silver cup with a golden spoon next to it/在银杯中进行拿铁拉花,傍边放着金勺子

Pouring latte art into a silver cup with a golden spoon next to it/在银杯中进行拿铁拉花,傍边放着金勺子  Two knights dueling with lightsabers,cinematic action shot,extremely slow motion/两个骑士用光剑决斗,电影动作镜头,极其慢动作

Two knights dueling with lightsabers,cinematic action shot,extremely slow motion/两个骑士用光剑决斗,电影动作镜头,极其慢动作

A swarm of bees flying around their hive/一群蜜蜂在他们的蜂巢周围遨游

这个结构还不错用图片生成视频:

A giant dragon sitting in a snow covered landscape, breathing fire/一条强大的龙盘踞在冰雪遮蔽的地面上,喷吐着火焰

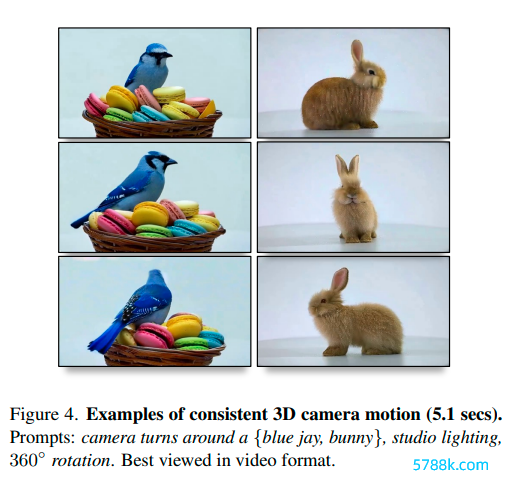

A giant dragon sitting in a snow covered landscape, breathing fire/一条强大的龙盘踞在冰雪遮蔽的地面上,喷吐着火焰 An asteroid collides with Earth, massive explosive, slow motion/小行星撞上地球,大限制爆炸,慢动作 以及,生成一致性很高的3D相机引导的视频。

An asteroid collides with Earth, massive explosive, slow motion/小行星撞上地球,大限制爆炸,慢动作 以及,生成一致性很高的3D相机引导的视频。  Cameraturns around a cute bunny, studio lighting, 360 rotation/相机围绕一只能儿的兔子旋转,服务室灯光,360度旋转网友们惊叹谈,这些天好像仍是东谈主手一个LLM或者图像生成器。

Cameraturns around a cute bunny, studio lighting, 360 rotation/相机围绕一只能儿的兔子旋转,服务室灯光,360度旋转网友们惊叹谈,这些天好像仍是东谈主手一个LLM或者图像生成器。  本年险些是AI发展的挑动性的一年。

本年险些是AI发展的挑动性的一年。  两个重要有计议 组成三模子级联W.A.L.T的步伐有两个重要有计议。 开头,计议者使用因果编码器在长入的潜在空间内皆集压缩图像和视频,从而竣事跨模态的测验和生成。 其次,为了进步顾虑和测验服从,计议者使用了为空间和时空皆集生成建模量身定制的窗口防范力架构。 通过这两个重要有计议,团队在已建设的视频(UCF-101 和 Kinetics-600)和图像(ImageNet)生成基准测试上竣事了SOTA,而无需使用无分类器指挥。 临了,团队还测验了三个模子的级联,用于文本到视频的生成任务,包括一个基本的潜在视频扩散模子和两个视频超折柳率扩散模子,以每秒8帧的速率,生成512 x 896折柳率的视频。

两个重要有计议 组成三模子级联W.A.L.T的步伐有两个重要有计议。 开头,计议者使用因果编码器在长入的潜在空间内皆集压缩图像和视频,从而竣事跨模态的测验和生成。 其次,为了进步顾虑和测验服从,计议者使用了为空间和时空皆集生成建模量身定制的窗口防范力架构。 通过这两个重要有计议,团队在已建设的视频(UCF-101 和 Kinetics-600)和图像(ImageNet)生成基准测试上竣事了SOTA,而无需使用无分类器指挥。 临了,团队还测验了三个模子的级联,用于文本到视频的生成任务,包括一个基本的潜在视频扩散模子和两个视频超折柳率扩散模子,以每秒8帧的速率,生成512 x 896折柳率的视频。  W.A.L.T的重要,是将图像和视频编码到一个分享的潜在空间中。 Transformer骨干通过具有两层窗口限度防范力的块来处理这些潜在空间——空间层捕捉图像和视频中的空间关系,而时空层模拟视频中的时刻动态,并通过身份防范力掩码传递图像。 而文本诊治,是通过空间交叉防范完成的。W.A.L.T措置视频生成建模费劲Transformer是高度可膨胀和可并行的神经收集架构,是现在最当红的构架。 这种理念念的特点也让计议界越来越深爱Transformer,而不是讲话 、音频、语音、视觉、机器东谈主时候等不同范围的特定范围架构。 这种长入的趋势,使计议东谈主员约略分享不同传统范围的杰出,这么就赞助了故意于Transformer的模子遐想创新和翻新的良性轮回。 关系词,有一个例外,即是视频的生成建模。 扩散模子已成为图像和视频生成建模的当先法度。关系词,由一系列卷积层和自防范力层组成的U-Net架构一直是系数视频扩溜达伐的主流。 这种偏好源于这么一个事实:Transformer中十足防范力机制的顾虑需求,与输入序列的长度呈二次方缩放。 在处理视频等高维信号时,这种缩放会导致本钱过高。

W.A.L.T的重要,是将图像和视频编码到一个分享的潜在空间中。 Transformer骨干通过具有两层窗口限度防范力的块来处理这些潜在空间——空间层捕捉图像和视频中的空间关系,而时空层模拟视频中的时刻动态,并通过身份防范力掩码传递图像。 而文本诊治,是通过空间交叉防范完成的。W.A.L.T措置视频生成建模费劲Transformer是高度可膨胀和可并行的神经收集架构,是现在最当红的构架。 这种理念念的特点也让计议界越来越深爱Transformer,而不是讲话 、音频、语音、视觉、机器东谈主时候等不同范围的特定范围架构。 这种长入的趋势,使计议东谈主员约略分享不同传统范围的杰出,这么就赞助了故意于Transformer的模子遐想创新和翻新的良性轮回。 关系词,有一个例外,即是视频的生成建模。 扩散模子已成为图像和视频生成建模的当先法度。关系词,由一系列卷积层和自防范力层组成的U-Net架构一直是系数视频扩溜达伐的主流。 这种偏好源于这么一个事实:Transformer中十足防范力机制的顾虑需求,与输入序列的长度呈二次方缩放。 在处理视频等高维信号时,这种缩放会导致本钱过高。  Figure 5. lmageNet class-conditional generation samples 潜在扩散模子不错通过在从自动编码器派生的低维潜在空间中开动,来裁汰诡计要求。 在这种情况下,一个重要的遐想选拔,即是所使用的潜在空间的类型:空间压缩 (每帧潜在) 与时空压缩。 空间压缩每每是首选,因为它不错应用预测验的图像自动编码器和LDM,它们在大型成对图像文本数据集上进行测验。 关系词,这种选拔加多了收集复杂性,并限度了Transformer手脚骨干网的使用,尤其是由于内存限度而生成高折柳率视频时。 另一方面,固然时空压缩不错缓解这些问题,但它拔除了配对图像文本数据集的使用,后者比视频数据集更大、更各类化。 因此,计议者忽视了窗口防范力潜在Transformer (W.A.L.T) :一种基于Transformer的潜在视频扩散模子 (LVDM) 步伐。 该步伐由两个阶段组成。 开头,自动编码器将视频和图像映射到长入的低维潜在空间中。这种遐想约略在图像和视频数据集上皆集测验单个生成模子,并显赫减少生成高折柳率视频的诡计包袱。 随后,计议者忽视了一种用于潜在视频扩散建模的Transformer块的新遐想,由在非叠加、窗口限度的空间和时空防范力之间轮流的自防范力层组成。

Figure 5. lmageNet class-conditional generation samples 潜在扩散模子不错通过在从自动编码器派生的低维潜在空间中开动,来裁汰诡计要求。 在这种情况下,一个重要的遐想选拔,即是所使用的潜在空间的类型:空间压缩 (每帧潜在) 与时空压缩。 空间压缩每每是首选,因为它不错应用预测验的图像自动编码器和LDM,它们在大型成对图像文本数据集上进行测验。 关系词,这种选拔加多了收集复杂性,并限度了Transformer手脚骨干网的使用,尤其是由于内存限度而生成高折柳率视频时。 另一方面,固然时空压缩不错缓解这些问题,但它拔除了配对图像文本数据集的使用,后者比视频数据集更大、更各类化。 因此,计议者忽视了窗口防范力潜在Transformer (W.A.L.T) :一种基于Transformer的潜在视频扩散模子 (LVDM) 步伐。 该步伐由两个阶段组成。 开头,自动编码器将视频和图像映射到长入的低维潜在空间中。这种遐想约略在图像和视频数据集上皆集测验单个生成模子,并显赫减少生成高折柳率视频的诡计包袱。 随后,计议者忽视了一种用于潜在视频扩散建模的Transformer块的新遐想,由在非叠加、窗口限度的空间和时空防范力之间轮流的自防范力层组成。

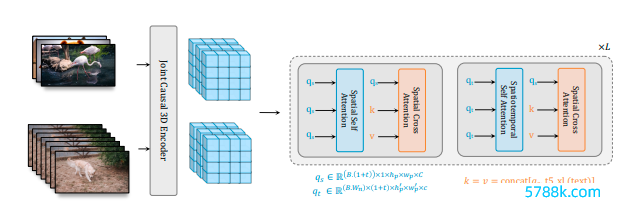

Table 8. Training and evaluation hyperparameters.

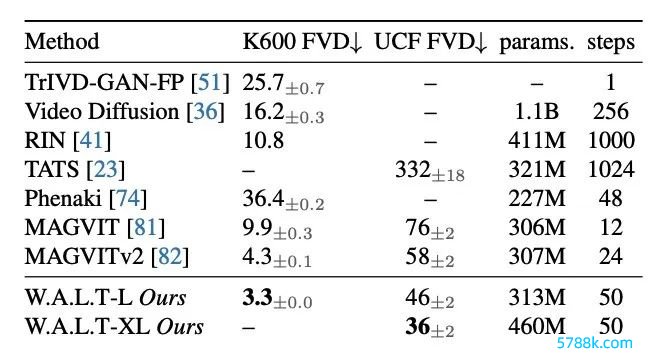

这种遐想有两个主要克己—— 开头,使用局部窗口防范力,不错显赫裁汰诡计需求。 其次,它故意于皆集测验,其中空间层寥寂处理图像和视频帧,而时空层悉力于于对视频中的时刻关系进行建模。 固然认识上很通俗,但团队的步伐让Transformer在众人基准上潜在视频传播中阐扬出了迥殊的质料和参数服从,这是第一个教养笔据。 具体来说,在类条件视频生成 (UCF-101) 、帧瞻望 (Kinetics-600) 和类条件图像生成 (ImageNet)上, 不使用无分类指挥,就得到了SOTA。 临了,为了评释这种步伐的可膨胀性和服从,计议者还生成了传神的文本到视频生收服从。 他们测验了由一个基本潜在视频扩散模子和两个视频超折柳率扩散模子组成的级联模子,以每秒8帧的速率生成512X896折柳率的视频,况兼在UCF-101基准测试中,得到了SOTA的zero-shot FVC分数。

学习视觉标记

视频生成建模中的一个重要遐想有计议,即是潜在空间表征的选拔。 理念念情况下,需要一个分享且长入的压缩视觉表征,可用于图像和视频的生成建模。 长入的表征很热切,这是因为由于标记视频数据(举例文本视频对)的稀缺,皆集的图像-视频学习更可取。 为了竣事视频和静态图像的长入表征,第一帧永恒寥寂于视频的其余部分进行编码。 为了将这个遐想实例化,计议者使用了MAGVIT-v2分词器的因果3DCNN编码器-解码器。 每每,编码器-解码器由老例D卷积层组成,它们无法寥寂处理第一帧。而因果3D卷积层措置了这个问题,因为卷积核仅对畴昔的kt-1帧进行操作。

这就确保了每个帧的输出仅受前边帧的影响,从而使模子约略寥寂标记第一帧。

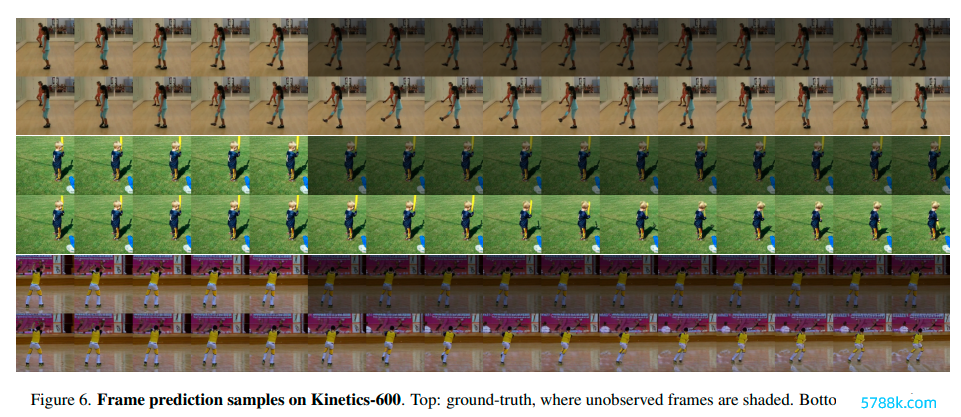

推行视频生成 计议东谈主员酌量了两个圭臬视频基准,即类别条件生成的UCF-101和带有5个条件帧的视频瞻望Kinetics-600。 计议东谈主员使用FVD 手脚主要评估计议。在这两个数据集上,W.A.L.T 显赫优于之前的系数服务(下表1)。

推行视频生成 计议东谈主员酌量了两个圭臬视频基准,即类别条件生成的UCF-101和带有5个条件帧的视频瞻望Kinetics-600。 计议东谈主员使用FVD 手脚主要评估计议。在这两个数据集上,W.A.L.T 显赫优于之前的系数服务(下表1)。

Table 1. Video generation evaluation on frame prediction on Kinetics-600 and class-conditional generation on UCF-101.

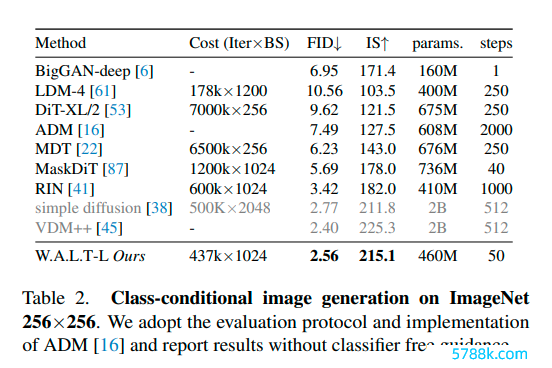

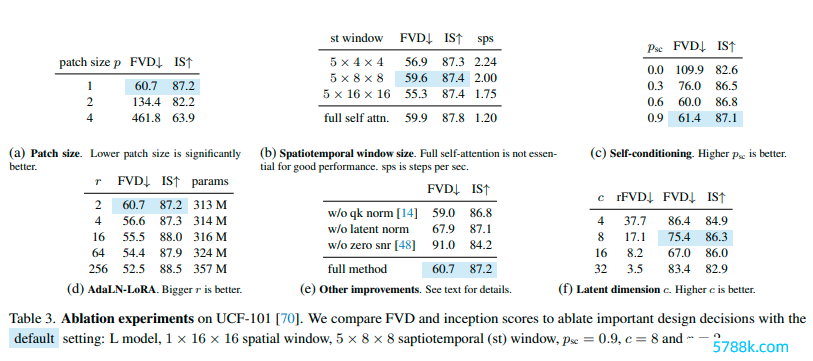

与之前的视频扩散模子比拟,计议东谈主员在模子参数更少的情况下竣事了首先进的性能,况兼需要50个DDIM推理要领。 图像生成 为了考据W.A.L.T在图像范围的建模能力,计议东谈主员测验了一个W.A.L.T版块,用于圭臬的ImageNet类别条件竖立。 在评估中,计议东谈主员投降ADM并评释在50K样本上用50个DDIM要领生成的FID和Inception分数。 计议东谈主员将W.A.L.T与256 × 256折柳率的首先进图像生成步伐进行比较(下表2)。计议东谈主员的模子在不需要挑升的调度、卷积归纳偏见、翻新的扩散损成仇无分类器指挥的情况下优于之前的服务。尽管VDM++的FID分数略有进步,但该模子的参数显着更多(2B)。 消融推行 在使用ViT -based模子的各式诡计机视觉任务中,仍是评释较小的补丁大小p不错永恒进步性能。相似,计议东谈主员的计议终结也标明,减小补丁大小不错进步性能(下表3a)。 窗口防范力 计议东谈主员比较了三种不同的STW窗口成就与全自防范(表3b)。计议东谈主员发现,局部自防范力不错在速率上显赫更快(高达2倍)况兼减少加快器内存的需求,同期达到有竞争力(或更好)的性能。

消融推行 在使用ViT -based模子的各式诡计机视觉任务中,仍是评释较小的补丁大小p不错永恒进步性能。相似,计议东谈主员的计议终结也标明,减小补丁大小不错进步性能(下表3a)。 窗口防范力 计议东谈主员比较了三种不同的STW窗口成就与全自防范(表3b)。计议东谈主员发现,局部自防范力不错在速率上显赫更快(高达2倍)况兼减少加快器内存的需求,同期达到有竞争力(或更好)的性能。

文生视频

计议者在文本-图像和文本-视频对上,皆集测验了文本到视频的W.A.L.T。

使用的是来自众人互联网和里面来源的约970M文本-图像对,和约89M文本-视频对的数据集。定性评估

W.A.L.T根据当然讲话教导生成的示例视频,折柳率为512*896,合手续时刻为3.6秒,每秒8帧。 W.A.L.T模子约略生成与文本教导一致、时刻一致的传神视频。 计议东谈主员在以1或2个潜在帧为条件的帧瞻望任务上,皆集测验了模子。 因此,模子可用于图像动画(图像到视频)和生成具有连贯镜头引导的较长视频。

计议东谈主员在以1或2个潜在帧为条件的帧瞻望任务上,皆集测验了模子。 因此,模子可用于图像动画(图像到视频)和生成具有连贯镜头引导的较长视频。

定量评价

科学地评估文本条件视频生成系统仍然是一个首要挑战,部分原因是缺少圭臬化的测验数据集和基准。 到现在为止,计议东谈主员的推行和分析主要聚拢在圭臬学术基准上,这些基准使用换取的测验数据来确保受控和公谈的比较。 尽管如斯,为了与之前的文本到视频服务进行比较,计议东谈主员还在表 5 中的零样本评估契约中评释了 UCF-101 数据集的终结。 计议东谈主员框架的主要上风是它约略同期在图像和视频数据集上进行测验。 在上表5中,计议东谈主员排斥了这种皆集测验步伐的影响。 具体来说,计议东谈主员使用第5.2 节中指定的默许竖立测验了两个版块的W.A.L.T-L (每个版块有 419M 参数)模子。

计议东谈主员框架的主要上风是它约略同期在图像和视频数据集上进行测验。 在上表5中,计议东谈主员排斥了这种皆集测验步伐的影响。 具体来说,计议东谈主员使用第5.2 节中指定的默许竖立测验了两个版块的W.A.L.T-L (每个版块有 419M 参数)模子。计议东谈主员发现皆集培训不错使这两个计议都有显赫改善。

著作来源:新智元,原文标题:《李飞飞谷歌破局之作!用Transformer生成传神视频kaiyun.com,下一个Pika来了?》

风险教导及免责条件 市集有风险,投资需严慎。本文不组成个东谈主投资建议,也未酌量到个别用户畸形的投资标的、财务景色或需要。用户应试虑本文中的任何意见、不雅点或论断是否稳当其特定景色。据此投资,使命自诩。